シャノンの定理とは

シャノンの定理とは、誤りの生じる(雑音のある)通話路であっても、誤りのない情報の伝送速度を、通話路容量に近づけられることを示した定理です。

通話路の容量を

シャノンの定理を導く

通信路の入力側につながれた情報源の1秒当たりのエントロピーを

文字の種類が

文字数が

従って①より、送信信号(入力)の文字列の総数は

その逆の確実に送信できない確率は以下で表されます。

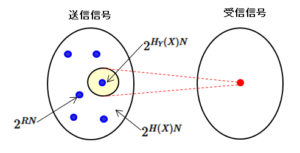

1つの受信信号(下図赤点)に対する送信信号(文字数列)の候補の数は、情報のあいまい度

この

この確率

これにより文字数列を長く取ることにより、1つの送信信号に対し1つの受信信号を対応させることができる、つまり雑音による影響を限りなく小さくできることが分かります。

数学

解析学、代数学、幾何学、統計学、論理・基礎論、情報・暗号、機械学習、金融・ゲーム理論、初等数学

散策路TOP

数学、応用数学、古典物理、量子力学、物性論、電子工学、IT、力学、電磁気学、熱・統計力学、連続体力学、解析学、代数学、幾何学、統計学、論理・基礎論、プラズマ物理、量子コンピュータ、情報・暗号、機械学習、金融・ゲーム理論